Por que a Segurança de IA da Agentic está se tornando o verdadeiro campo de batalha de IA empresarial

Ethan Carter

Add Subtitle oferece às marcas e criadores total controle sobre como sua mensagem é apresentada ao mundo. Legendas, narração e tradução—tudo em uma única ferramenta para agilizar o fluxo de trabalho de seus vídeos.

No último ano, as conversas sobre IA empresarial focaram principalmente em capacidade: quais modelos são mais fortes, quais copilotos são mais rápidos e quais plataformas podem automatizar mais trabalho. Mas em 2026, essa discussão está amadurecendo. À medida que as empresas avançam de testar assistentes para implantar sistemas agêncios, a verdadeira pergunta não é mais apenas o que esses sistemas podem fazer. É se eles podem ser confiáveis para fazê-lo com segurança.

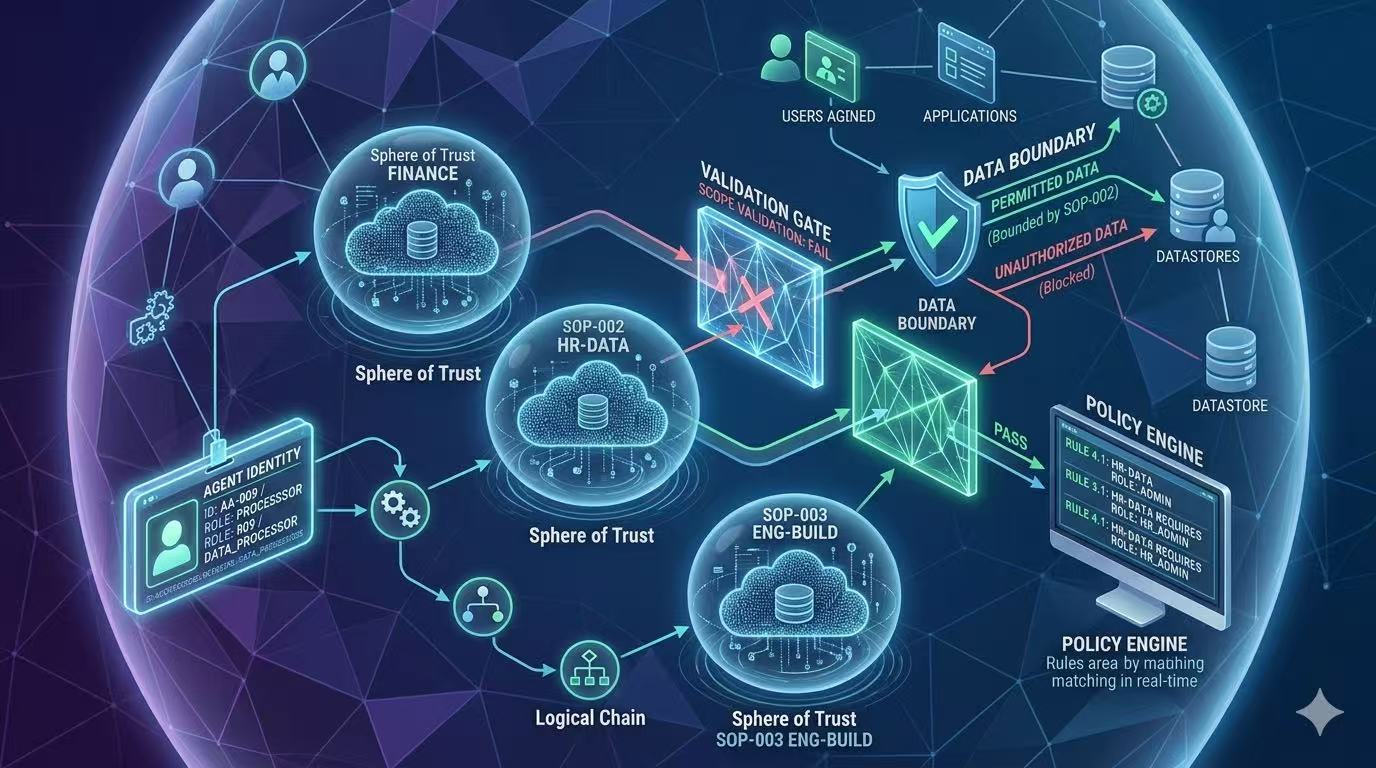

Essa mudança é importante porque a IA agêncial é fundamentalmente diferente das ferramentas de IA passivas. Um agente autônomo ou semi-autônomo pode obter dados, acionar fluxos de trabalho, tomar decisões subsequentes, interagir com sistemas empresariais e atuar na velocidade da máquina. Uma vez que a IA começa a operar dentro de processos de negócios em tempo real, a segurança deixa de ser uma preocupação secundária e se torna uma infraestrutura central.

A AI Agentic muda a equação de segurança porque expande tanto a capacidade quanto a exposição ao mesmo tempo. Quanto mais útil um agente de IA se torna, mais sistemas ele pode acessar, mais dados ele pode acessar e mais riscos ele introduz se identidade, permissões e limites forem mal projetados.

🛡️ Por que a segurança de IA agentes está se tornando o verdadeiro campo de batalha das empresas

As empresas estão avançando de copilotos de IA para agentes de IA que podem agir, decidir e desencadear fluxos de trabalho. Isso torna a segurança, o controle de acesso e a governança a próxima camada real de infraestrutura competitiva.

👉 Leia a análise completa na página do produto Addsubtitle / inscreva-se: https://www.addsubtitle.ai/

Agentes de IA estão mudando o que "implantação" significa

Implantações tradicionais de software empresarial geralmente envolvem modelos de permissões previsíveis, fluxos de trabalho delimitados e ações de usuário claramente definidas. A IA agentificada quebra esse padrão. Em vez de esperar que um humano complete cada etapa, esses sistemas podem interpretar o contexto, escolher entre múltiplos caminhos e agir com um grau de autonomia.

Isso parece poderoso—porque é. Mas também significa que a superfície de ataque está mudando. Um painel de controle estático raramente improvisa. Um agente de IA pode. E quando o software pode interpretar intenções, encadear tarefas e tocar múltiplos sistemas, as organizações precisam de um novo modelo de segurança construído para comportamentos dinâmicos ao invés de lógica fixa.

Por que a identidade se torna o centro do problema

O primeiro grande problema é a identidade. Em uma configuração tradicional, a identidade do usuário é relativamente clara: uma pessoa faz login, uma função é atribuída, permissões são aplicadas. Mas com a IA agentificada, a identidade torna-se em camadas e ambígua.

Perguntas surgem imediatamente:

O agente está agindo em nome de um usuário ou de forma independente?

Quais sistemas ele está autorizado a acessar?

Por quanto tempo o acesso deve persistir?

O que acontece quando um agente encadeia tarefas entre ferramentas com diferentes modelos de permissão?

Como as organizações devem auditar ações tomadas por IA ao invés de humanos?

É por isso que a gestão de identidade e acesso está se tornando central para a arquitetura de IA corporativa. Se as organizações não sabem exatamente quem é um agente, o que ele pode acessar e sob quais restrições ele opera, o restante da pilha de IA torna-se muito mais difícil de confiar.

O problema de segurança não é apenas ataque externo

Muita discussão sobre segurança de IA ainda soa como cibersegurança tradicional: prevenindo violações, bloqueando atacantes, reduzindo exposição externa. Esses problemas ainda importam, mas a IA agentificada introduz uma categoria diferente de risco—ação interna desalinhada ou com permissão excessiva.

Um agente de IA não precisa ser malicioso para criar danos. Ele pode tomar uma ação incorreta devido a um contexto incompleto. Pode apresentar os dados errados para a pessoa errada. Pode extrapolar porque as permissões foram delimitadas de forma frouxa. Pode disparar fluxos de trabalho mais rápido do que os humanos podem revisá-los.

Isso significa que o risco de IA corporativa está cada vez mais sobre:

acesso excessivo

desejos inadequadamente projetados

auditoria fraca

falta de limiares de aprovação

responsabilidade pouco clara por ações de agentes

Por que a governança está se tornando um requisito de produto

Um dos sinais mais claros em 2026 é que a governança não é mais um revestimento opcional de conformidade. Está se tornando parte do próprio requisito do produto.

As empresas querem IA que seja útil, mas também querem IA que seja explicável, delimitada, observável e interrompível. Isso significa que a governança precisa operar em todo o ciclo de vida:

ingestão de dados

acesso ao modelo

contexto do prompt

permissões de ferramenta

açãos a jusante

registro e revisão

É aqui que as plataformas de IA corporativas mais fortes se diferenciarão. O mercado ainda pode celebrar novas capacidades, mas as decisões reais de implantação dependerão cada vez mais de quem pode oferecer sistemas de IA seguros, governáveis e conscientes de políticas.

As equipes de segurança estão se tornando equipes de infraestrutura de IA

Outra grande mudança é organizacional. As equipes de segurança não estão mais apenas avaliando o risco de IA depois do fato. Elas estão se tornando arquitetas ativas da implantação de IA.

Isso significa que a segurança está se movendo para upstream. Em vez de perguntar, "Como garantimos a segurança dessa ferramenta de IA após a sua adoção?" as equipes agora estão perguntando:

Como definimos a identidade confiável de um agente?

Quais políticas deverão se aplicar antes da implantação?

Quais fluxos de trabalho requerem aprovação humana?

Como monitoramos o comportamento do agente ao longo do tempo?

O que conta como ação anormal ou insegura para um sistema de IA?

Nesse sentido, a segurança da IA agentificada não é apenas uma função defensiva. Está se tornando uma infraestrutura viabilizadora para a própria IA corporativa.

Os próximos vencedores em IA corporativa serão os mais confiáveis

Muitas empresas ainda presumem que a corrida da IA será vencida por quem automatizar mais trabalho primeiro. Isso é apenas parcialmente verdadeiro. Em configurações corporativas, a vantagem mais durável pode pertencer às organizações que podem automatizar de forma responsável.

Um agente poderoso, mas mal governado, pode criar hesitação. Um sistema ligeiramente mais restrito, mas altamente confiável, pode acelerar a adoção. Os compradores corporativos entendem isso. Eles não querem apenas capacidade—eles querem confiança.

É por isso que a segurança da IA agentificada está surgindo como uma das categorias estratégicas mais importantes no mercado. Não é um freio à inovação. É a condição que permite que a inovação escale.

Se sua organização está avançando em direção à IA agente, agora é o momento de tratar segurança e governança como arquitetura do produto — e não como limpeza após a implantação. As empresas que definem acesso confiável, limites claros e supervisão rigorosa desde o início serão aquelas mais bem posicionadas para escalar a IA com confiança.

É gratuito