لماذا أصبحت أمان الذكاء الاصطناعي الوكيل ساحة المعركة الحقيقية للذكاء الاصطناعي في المؤسسات

إيثان كارتر

إضافة الترجمة تعطي العلامات التجارية والمبدعين السيطرة الكاملة على كيفية تقديم رسالتهم للعالم. الترجمة النصية، والتعليق الصوتي، والترجمة - كل ذلك في أداة واحدة لتسريع سير عمل الفيديو لديك.

على مدى العام الماضي، كانت محادثات الذكاء الاصطناعي في المؤسسات تركز في الغالب على القدرات: أي النماذج هي الأقوى، وأي المساعدين هم الأسرع، وأي المنصات يمكنها أتمتة المزيد من الأعمال. لكن في عام 2026، أصبحت تلك المناقشة تتطور. مع انتقال الشركات من اختبار المساعدين إلى نشر الأنظمة الوكلائية، فإن السؤال الحقيقي لم يعد فقط ما يمكن أن تفعله هذه الأنظمة. بل يتعلق الأمر بما إذا كان يمكن الثقة بها للقيام بذلك بأمان.

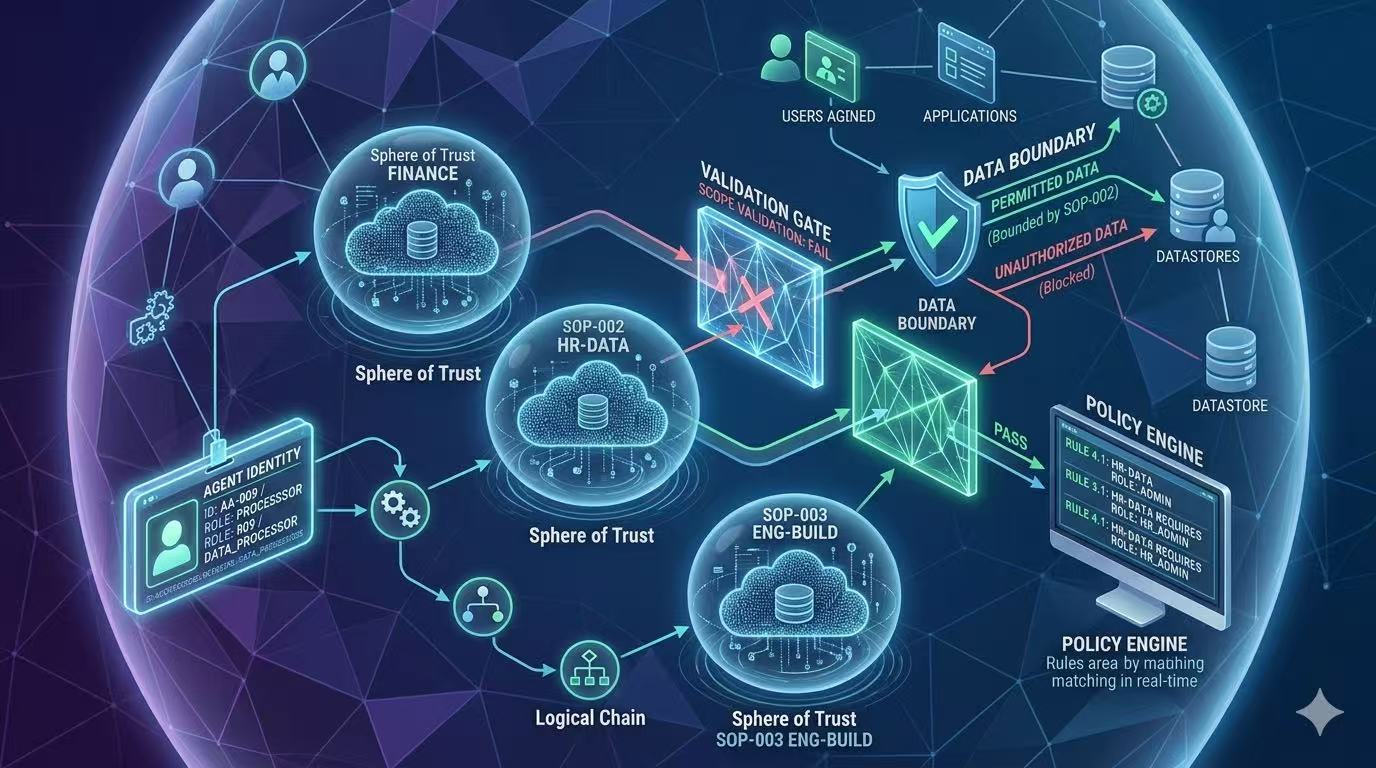

تعتبر هذه النقلة مهمة لأن الذكاء الاصطناعي الوكالي يختلف جوهريًا عن أدوات الذكاء الاصطناعي السلبية. يمكن لوكيل مستقل أو شبه مستقل استرجاع البيانات، وتحفيز سير العمل، واتخاذ القرارات النهائية، والتفاعل مع أنظمة المؤسسات، والعمل بسرعة الآلات. بمجرد أن يبدأ الذكاء الاصطناعي في العمل داخل عمليات الأعمال الحية، فإن الأمن يتوقف عن كونه ظرفًا جانبيًا ليصبح بنية أساسية أساسية.

يغير الذكاء الاصطناعي الوكالات معادلة الأمان لأنه يزيد من القدرة والتعرض في نفس الوقت. كلما أصبح عميل الذكاء الاصطناعي أكثر فائدة، كلما استطاعت الأنظمة أن تتأثر، وكلما تمكنت من الوصول إلى بيانات أكثر، وكلما زادت المخاطر التي تقدمها إذا تم تصميم الهوية والأذونات والإرشادات بشكل سيئ.

🛡️ لماذا أصبحت أمان الذكاء الاصطناعي الفعال ساحة المعركة الحقيقية للمؤسسات

تنتقل المؤسسات من مساعدي الذكاء الاصطناعي إلى وكلاء الذكاء الاصطناعي القادرين على العمل واتخاذ القرار وتفعيل سير العمل. هذا يجعل الأمان، والتحكم في الوصول، والحوكمة الطبقة الحقيقية التالية من البنية التحتية التنافسية.

👉 اقرأ التحليل الكامل صفحة منتج Addsubtitle / اشترك: https://www.addsubtitle.ai/

تغير وكلاء الذكاء الاصطناعي ما يعنيه "النشر"

عادةً ما تتضمن عمليات نشر البرمجيات التقليدية في المؤسسات نماذج إذن متوقعة، وإجراءات عمل محدودة، وإجراءات مستخدم واضحة. يُحدث الذكاء الاصطناعي الوكالات اضطرابًا في هذا النمط. بدلاً من انتظار إنجاز إنسان لكل خطوة، يمكن لهذه الأنظمة تفسير السياق، واختيار مسارات متعددة، والعمل بدرجة من الاستقلالية.

يبدو أن هذا قويًّا - لأنه كذلك. لكنه يعني أيضًا أن نطاق الهجوم يتغير. نادرًا ما يقوم لوح التحكم الثابت بالعصف الذهني. وقد يقوم وكيل الذكاء الاصطناعي بذلك. وعندما تستطيع البرمجيات تفسير النية، ربط المهام، والتفاعل مع أنظمة متعددة، تحتاج المؤسسات إلى نموذج أمان جديد مُصمم للسلوك الديناميكي بدلاً من المنطق الثابت.

لماذا تصبح الهوية مركز المشكلة

تتمثل أول مشكلة كبرى في الهوية. في إعداد تقليدي، تكون هوية المستخدم واضحة نسبيًا: يقوم شخص ما بتسجيل الدخول، يتم تعيين دور، وتُطبق الأذونات. ولكن مع الذكاء الاصطناعي الوكالات، تصبح الهوية متعددة الطبقات وغامضة.

تظهر الأسئلة على الفور:

هل يعمل الوكيل نيابةً عن مستخدم أو بشكل مستقل؟

ما الأنظمة التي يُسمح له بالوصول إليها؟

إلى متى ينبغي أن تستمر صلاحية الوصول؟

ماذا يحدث عندما يربط الوكيل المهام عبر أدوات بنماذج إذن مختلفة؟

كيف ينبغي على المنظمات مراجعة الإجراءات التي يتخذها الذكاء الاصطناعي بدلاً من البشر؟

لهذا السبب أصبحت إدارة الهوية والوصول مركزية في بنية الذكاء الاصطناعي بالمؤسسات. إذا لم تكن المنظمات تعرف بالضبط من هو الوكيل، وما يمكنه التفاعل معه، وفي ظل أي قيود يعمل، فإن بقية مجموعة الذكاء الاصطناعي تصبح أكثر صعوبة في الثقة بها.

قضية الأمان ليست مجرد هجوم خارجي

لا تزال الكثير من مناقشات أمان الذكاء الاصطناعي تبدو مثل الأمن السيبراني التقليدي: منع الاختراقات، وصد المهاجمين، وتقليل التعرض الخارجي. لا تزال تلك القضايا مهمة، لكن الذكاء الاصطناعي الوكالات يقدم فئة مختلفة من المخاطر - أفعال داخلية غير متطابقة أو غير مسموح بها بشكل زائد.

لا يحتاج وكيل الذكاء الاصطناعي إلى أن يكون خبيثًا لإحداث الضرر. يمكنه اتخاذ إجراء غير صحيح بسبب السياق غير المكتمل. يمكنه عرض البيانات الخاطئة على الشخص الخطأ. يمكنه تجاوز الصلاحيات بصورة مرخّصة. يمكنه تفعيل إجراءات العمل بسرعة أكبر مما يمكن للبشر مراجعتها.

هذا يعني أن مخاطر الذكاء الاصطناعي بالمؤسسات تدور بشكل متزايد حول:

الوصول المفرط

تصميم حواجز ضعيفة

ضعف إمكانية التدقيق

عدم وضوح حدود الموافقات

مساءلة غير واضحة لأفعال الوكيل

لماذا تصبح الحوكمة متطلبًا للمنتجات

أحد الإشارات الأكثر وضوحًا في 2026 هو أن الحوكمة لم تعد مجرد غلاف امتثال اختياري. إنها تصبح جزءًا من متطلبات المنتج نفسها.

تريد المؤسسات الذكاء الاصطناعي الذي يكون مفيدًا، لكنها ترغب أيضًا في ذكاء اصطناعي يمكن تفسيره، محدود، قابل للرصد، وقابل للإيقاف. وهذا يعني أن الحوكمة يجب أن تعمل عبر دورة الحياة الكاملة:

استيعاب البيانات

الوصول إلى النماذج

سياق المطالبات

أذونات الأدوات

الإجراءات السفلية

التسجيل والمراجعة

هنا هي النقطة التي ستتميز فيها أقوى منصات الذكاء الاصطناعي في المؤسسات. قد تحتفل السوق بقدرات جديدة، لكن قرارات نشر الفعلية ستعتمد بشكل متزايد على من يمكنه تقديم أنظمة ذكاء اصطناعي آمنة، قابلة للحوكمة، وواعية للسياسات.

فِرق الأمان تتحول إلى فرق بنية تحتية للذكاء الاصطناعي

يتعلق تغيير رئيس آخر بالمنظمات. لم تعد فرق الأمان تقيم مخاطر الذكاء الاصطناعي بعد الواقعة. إنهم يتحولون إلى المهندسين النشطين لنشر الذكاء الاصطناعي.

وهذا يعني أن الأمان يتحرك للأعلى. بدلاً من السؤال، "كيف نؤمن هذه الأداة الذكية بعد اعتمادها؟"، أصبح الفرق الآن يسأل:

كيف نحدد هوية الوكيل الموثوق بها؟

ما السياسات التي ينبغي تطبيقها قبل النشر؟

أي إجراءات تتطلب موافقة بشرية؟

كيف نراقب سلوك الوكيل على مر الزمن؟

ماذا يُعتبر عملاً غير طبيعي أو غير آمن لنظام الذكاء الاصطناعي؟

من هذه الناحية، فإن أمان الذكاء الاصطناعي الوكالات ليس مجرد وظيفة دفاعية. إنه يصبح بنية تحتية تمكينية للذكاء الاصطناعي في المؤسسات بذاتها.

ستكون الفائزين في الذكاء الاصطناعي بالمؤسسات الأكثر موثوقية

لا تزال العديد من الشركات تفترض أن السباق في الذكاء الاصطناعي سيفوز به من يستطيع أتمتة أكبر قدر من العمل أولاً. هذا صحيح جزئيًا فقط. في الإعدادات المؤسساتية، قد تنتمي الميزة الأكثر ديمومة إلى المنظمات التي تستطيع الأتمتة بصورة مسؤولة.

يمكن لوكيل قوي ولكنه غير مُدار بشكل جيد أن يخلق ترددًا. نظام ذو ثقة عالية ولكنه أضيق قليلاً يمكن أن يفتح باب الاعتماد بسرعة أكبر. يفهم مشتروا المؤسسات هذا. إنهم لا يريدون فقط القدرة - بل يريدون الثقة.

لهذا السبب يظهر أمان الذكاء الاصطناعي الوكالات كواحد من أهم الفئات الاستراتيجية في السوق. إنه ليس عائقًا أمام الابتكار. إنه الشرط الذي يسمح للابتكار بالنمو.

إذا كانت مؤسستك تتحرك نحو الذكاء الاصطناعي الوكالي، فإن الوقت الحالي هو الوقت المناسب للتعامل مع الأمان والحوكمة كمعمارية منتج - وليس كتنظيف بعد النشر. الشركات التي تحدد الوصول الموثوق والحدود الواضحة والإشراف القوي مبكرًا ستكون هي الأفضل تمركزًا لتوسيع نطاق الذكاء الاصطناعي بثقة.

إنه مجاني