なぜエージェンティックAIセキュリティが本当のエンタープライズAIの競争領域になりつつあるのか

イーサン・カーター

Add Subtitleは、ブランドやクリエイターに、自分たちのメッセージを世界に届ける方法の完全なコントロールを提供します。字幕、ボイスオーバー、翻訳を一つのツールで実現し、ビデオ制作のワークフローを効率化します。

過去1年間、エンタープライズAIの会話は主に能力に焦点を当てていました: どのモデルが最も強力で、どのコパイロットが最も速く、どのプラットフォームがより多くの作業を自動化できるか。しかし、2026年にはその議論が成熟しています。企業がアシスタントのテストからエージェンティックシステムの展開に移行するにつれて、重要なのはこれらのシステムが何をできるかというだけではなく、それを安全に実行できるかどうかです。

このシフトは重要です。なぜなら、エージェンティックAIは受動的なAIツールとは根本的に異なるからです。自律型または半自律型のエージェントは、データの取得、ワークフローのトリガー、下流での意思決定、エンタープライズシステムとの相互作用を行い、マシンの速度で行動できます。AIが実際のビジネスプロセス内で稼働し始めると、セキュリティは副次的な懸念でなくなり、コアインフラストラクチャになります。

エージェンティックAIは、同時に能力とリスクを拡大するため、セキュリティの方程式を変えます。AIエージェントがより有用になるほど、触れることのできるシステムが増え、アクセス可能なデータが増え、アイデンティティ、許可、ガードレールが不十分に設計されている場合のリスクも増加します。

🛡️ なぜエージェントAIのセキュリティが本当の企業の戦場になりつつあるのか

企業はAIコパイロットから、行動し、決定し、ワークフローをトリガーできるAIエージェントに移行しています。それにより、セキュリティ、アクセス制御、およびガバナンスが、競争力のあるインフラストラクチャの次の本当のレイヤーになります。

👉 詳細分析を読む Addsubtitle製品ページ/サインアップ:https://www.addsubtitle.ai/

AIエージェントが「デプロイメント」の意味を変える

従来のエンタープライズソフトウェアデプロイメントは、予測可能な権限モデル、限定されたワークフロー、明確に定義されたユーザーアクションを通常含んでいます。エージェントAIはそのパターンを破ります。これらのシステムは、人間がすべてのステップを完了するのを待つ代わりに、コンテキストを解釈し、複数のパスから選択し、ある程度の自律性を持って行動することができます。

それは強力に聞こえます—実際、そうです。しかし、それは攻撃の表面が変わることも意味します。静的なダッシュボードは即興で動くことは滅多にありません。しかし、AIエージェントはできるかもしれません。そして、ソフトウェアが意図を解釈し、タスクを連鎖し、複数のシステムに触れることができるとき、組織は固定されたロジックではなく、動的な行動のために構築された新しいセキュリティモデルを必要とします。

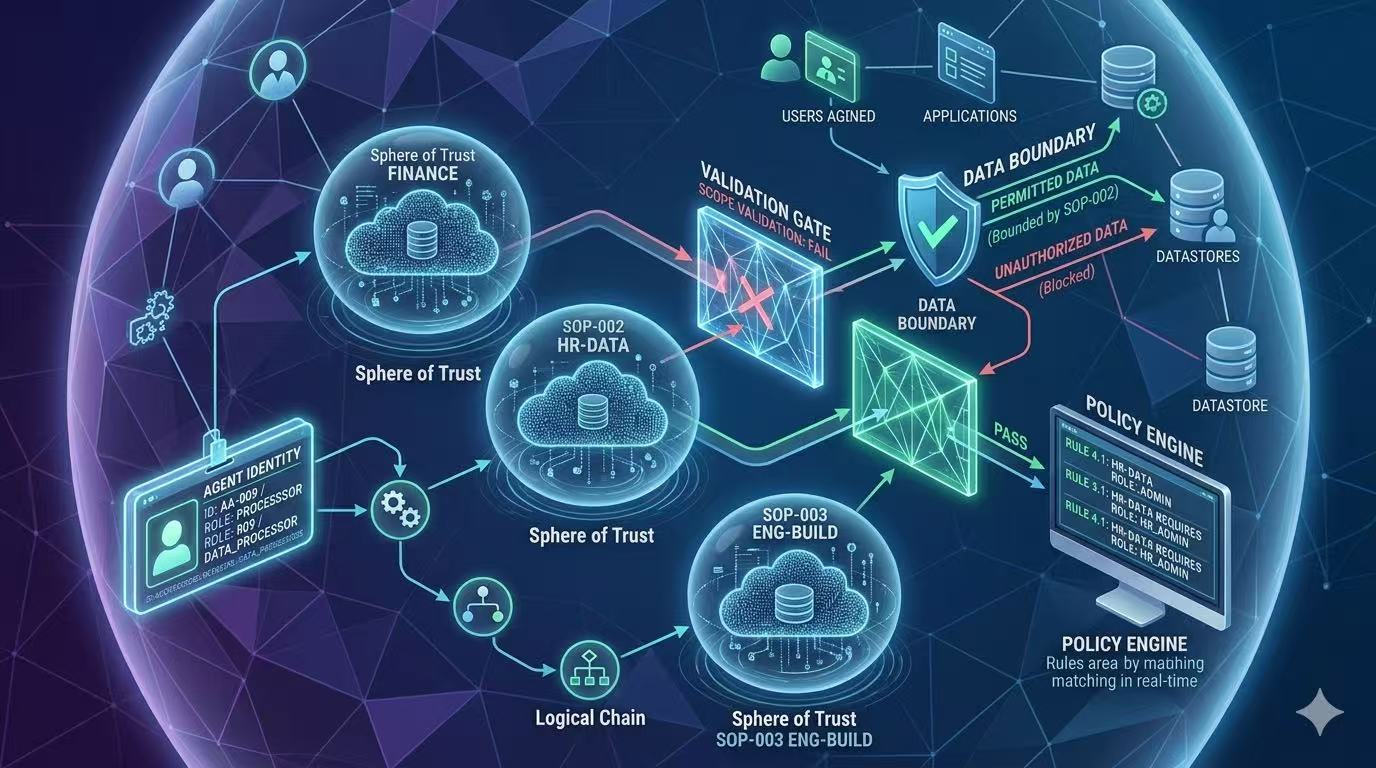

なぜアイデンティティが問題の中心になるのか

最初の大きな問題はアイデンティティです。従来のセットアップでは、ユーザーアイデンティティは比較的明確です:人がログインし、役割が割り当てられ、権限が施行されます。しかし、エージェントAIでは、アイデンティティが層重なり、曖昧になります。

すぐに質問が湧きます:

エージェントはユーザーを代表して行動しているのか、それとも独立して行動しているのか?

どのシステムにアクセスすることが許可されているのか?

アクセスはどれくらいの間続くべきか?

エージェントが異なる権限モデルを持つツールを跨いでタスクを連鎖するときは何が起こるか?

人間ではなくAIによって行われたアクションを組織はどのように監査すべきか?

これがアイデンティティとアクセス管理が企業AIアーキテクチャの中心になりつつある理由です。組織がエージェントが何者で、何に触れ、どのような制約の下で動作しているのかを正確に知らない場合、AIスタックの信頼性が大幅に低下します。

セキュリティ問題は外部攻撃だけではありません

多くのAIセキュリティの議論は依然として伝統的なサイバーセキュリティのように響きます:侵害の防止、攻撃者のブロック、外部への露出の削減。これらの問題は依然として重要ですが、エージェントAIは異なるリスクカテゴリーを導入します—不一致または過度に許可された内部アクション。

AIエージェントは悪意がなくても損害を与えることがあります。不完全なコンテキストのために誤ったアクションを取ることがあります。誤ったデータを誤った人に提示することがあります。権限が緩く設定されていたために範囲を超えることがあります。人間がレビューするよりも速くワークフローをトリガーすることがあります。

これが意味するのは、企業AIリスクはますます以下のようになります:

過剰なアクセス

不十分なガードレール設計

弱い監査可能性

欠けている承認のしきい値

エージェントアクションに対する曖昧な責任

ガバナンスが製品要件になっている理由

2026年における最も明確なシグナルの一つは、ガバナンスがもはやオプションのコンプライアンス包装ではなくなっているということです。製品要件の一部となりつつあります。

企業は有用なAIを求めていますが、明確に説明可能で、制約され、観察でき、中断可能なAIも求めています。それは、ガバナンスが全ライフサイクルにわたって機能することを意味します:

データの取り込み

モデルアクセス

プロンプトコンテキスト

ツールの権限

下流のアクション

ログ記録とレビュー

これが、最も強力な企業AIプラットフォームが自らを差別化するところです。市場は新しい能力を祝うかもしれませんが、実際のデプロイメントの決定は、誰が安全で、ガバナンス可能で、ポリシーに認識したAIシステムを提供できるかにますます依存しています。

セキュリティチームはAIインフラチームになりつつある

もう一つの大きな変化は組織の在り方です。セキュリティチームはもはやAIリスクを後から評価するだけではありません。彼らはAIデプロイメントの積極的な設計者になりつつあります。

これは、セキュリティが上流に動いていることを意味します。「AIツールを採用した後にどのようにこれを保護するか?」ではなく、今では:「

信頼できるエージェントのアイデンティティをどのように定義するか?

デプロイメント前に適用すべきポリシーはどれか?

どのワークフローが人間による承認を必要とするか?

エージェントの行動をどのように監視するか?

AIシステムにとって異常または安全ではない行動とは何か?

そのような意味で、エージェントAIセキュリティは単なる防御機能ではなくなっています。それは企業AI自体のための支援インフラとなりつつあります。

次の企業AIの勝者は最も信頼されるものになる

多くの企業は、AI競争は誰が最初に多くの作業を自動化するかにかかっているといまだに仮定しています。それは部分的にしか正しくありません。企業の現場では、より持続可能な優位性は、責任を持って自動化できる組織に属するかもしれません。

強力だが管理が悪いエージェントはためらいを生む可能性があります。少しばかり狭いが非常に信頼できるシステムは採用を速めることができます。企業の買い手はこれを理解しています。彼らが求めているのは、単なる能力ではなく、確信です。

これが、エージェントAIセキュリティが市場で最も重要な戦略的カテゴリーの一つとして浮上してきた理由です。それはイノベーションに対するブレーキではありません。それはイノベーションがスケールすることを可能にする条件です。

あなたの組織がエージェント型AIに移行している場合、今こそセキュリティとガバナンスを製品アーキテクチャとして扱う時です。展開後の整理としてではありません。信頼できるアクセス、明確な境界、強力な監督を早期に定義する企業が、自信を持ってAIをスケールするための最良のポジションに立つことができます。

無料です